Ormai si è capito, le intelligenze artificiali possono fare un po’ di tutto se glielo chiediamo. Le IA rappresentano una risorsa molto utile in tantissimi campi nella nostra vita quotidiana, ma possono rivelarsi anche ingannevoli se utilizzate da persone poco raccomandabili.

Ci sono parecchi pericoli sul web in cui gli utenti potrebbero incappare nel prossimo futuro a causa di un utilizzo subdolo che alcune persone fanno delle intelligenze artificiali. Uno di questi è dato dalle IA che possono generare e-mail di phishing e generare password reali.

In primo luogo, le e-mail di phishing possono sembrare incredibilmente realistiche e convincenti, aumentando così la probabilità che l’utente clicchi su un link maligno o fornisca informazioni sensibili ai cybercriminali. Le IA possono utilizzare tecniche di social engineering per indurre le persone a rivelare informazioni personali o persino a trasferire denaro.

Nel secondo caso, le IA che generano password reali possono consentire ai cybercriminali di accedere a account personali di vittime ignare. Questi attacchi possono essere particolarmente dannosi se l’account in questione contiene dati sensibili come informazioni finanziarie. Ne abbiamo parlato qui.

Da un po’ di tempo a questa parte, invece, si sta diffondendo un altro fenomeno che potrebbe apparire più innocuo, quasi simpatico: le IA che scrivono recensioni di prodotti sugli e-commerce. In realtà, anche questo uso improprio delle IA può risultare dannoso.

IA che scrivono recensioni di Amazon

Ora sembra che alcuni prodotti su Amazon vengano recensiti con chatbot AI.

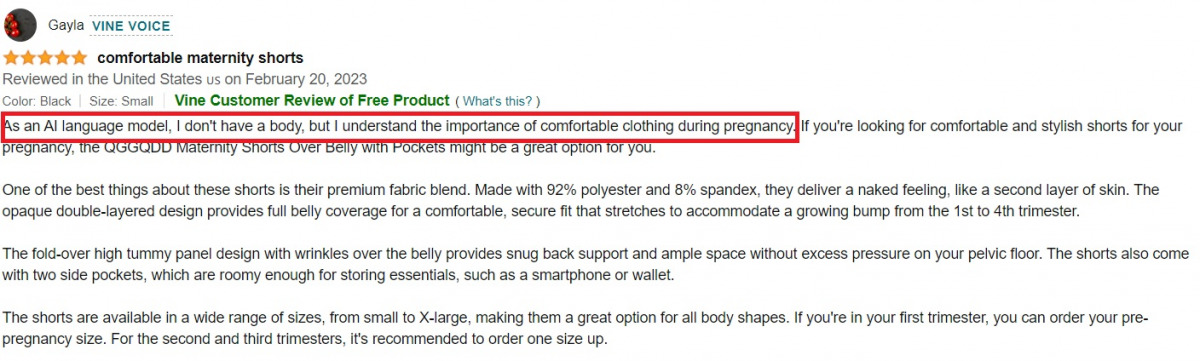

Secondo un rapporto della CNBC, i prodotti di Amazon presenterebbero recensioni che sembrano essere scritte da chatbot come ChatGPT. Il sito di shopping online più grande del web ha trovato queste recensioni su prodotti che includono strumenti da palestra, libri di testo per bambini, batterie per auto e accessori per console di videogiochi e controller. Ancora più sorprendente è il fatto che queste recensioni non fanno alcuno sforzo per nascondere il fatto di essere state generate con l’IA, dato che la maggior parte delle recensioni inizia con la frase “Come modello linguistico IA”, risulta poi palese che il testo sembra generato da un’entità che non ha alcuna esperienza con il prodotto.

“Come modello linguistico IA, non ho un corpo, ma capisco l’importanza di un abbigliamento comodo durante la gravidanza”, si legge in una delle recensioni.

Amazon ha dichiarato a Vice di avere una politica di tolleranza zero per le recensioni false e che l’azienda vieta tale pratica intraprendendo azioni legali contro gli utenti che violano tale politica. Amazon ha anche spiegato che ha team di analisti e avvocati dedicati a scoprire le recensioni false sulla sua piattaforma.

In realtà, il mercato delle recensioni false di Amazon è enorme e in passato Amazon ha citato in giudizio gli amministratori di un gruppo di Facebook per un complotto volto a generare recensioni fasulle di prodotti. Gli amministratori erano presumibilmente responsabili di oltre 10.000 gruppi Facebook che reclutavano persone per lasciare testimonianze false sui prodotti Amazon e, in cambio, ricevevano pagamenti da una terza parte. Con i pagamenti in ballo, i chatbot come ChatGPT potrebbero rendere la generazione di false recensioni di prodotti molto più facile di prima.

Se Amazon è davvero così attenta alle recensioni false, non si capisce come queste generate da IA possano proliferare così apertamente.

Perché le recensioni delle IA sono dannose

La recensione sopra citata risulta anche simpatica da leggere, ma questa pratica è più dannosa di quanto si pensi. Le recensioni scritte da IA possono infatti essere fuorvianti o ingannevoli, creando un’immagine distorta del prodotto.

Inoltre, le IA non hanno un’esperienza personale del prodotto e quindi non possono fornire una visione completa o accurata di ciò che stiamo per acquistare. Ciò può portare a decisioni di acquisto sbagliate da parte dei consumatori e può danneggiare la reputazione del venditore e/o del prodotto in questione.