ChatGPT è ormai noto per i suoi strafalcioni, ma ciò che è successo di recente ha davvero dell’incredibile: coinvolto in un caso giudiziario.

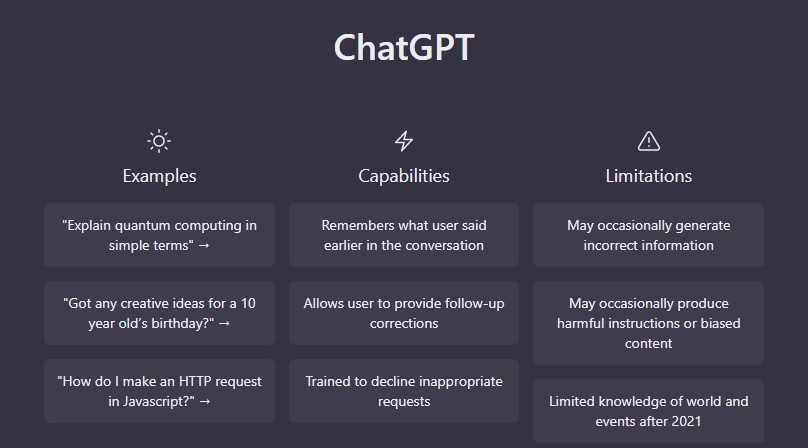

Le intelligenze artificiali generative sono un piccolo gioiello della tecnologia ma, come abbiamo visto più volte, hanno ancora diversi limiti.

ChatGPT, il chatbot ideato da OpenAI, più volte è stato protagonista in negativo di alcune vicende nelle quali ha mostrato una serie di errori anche abbastanza sorprendenti.

Stavolta però non si tratta di semplici errori matematici o di fallimenti di test universitari, ma di una situazione di gran lunga più seria che poteva finire anche nel peggiore dei modi.

Stiamo parlando infatti di un reale caso giudiziario dove il software di OpenAI stava rischiando di far finire in galera degli uomini innocenti.

Detta così sembra davvero un qualcosa di veramente assurdo, ma vi assicuriamo che è tutto vero e dimostra ancora una volta quanto le intelligenze artificiali generative siano diventate ormai molto influenti.

Se prima venivano usate soltanto per curiosità o piccole ricerche, adesso viene utilizzata anche per provare a risolvere casi in tribunale.

Chiede aiuto a ChatGPT, ma è l’errore più grosso della sua vita

ChatGPT, come molti sanno, è un modello accessibile a tutti ed è facilmente utilizzabile da chiunque senza particolari capacità informatiche.

È chiaro che, come la stessa OpenAI ha ammesso, non si tratta di un pozzo di verità assoluta, ma soltanto un’intelligenza artificiale che genera risposte coerenti con il prompt dell’utente.

Le informazioni generate dai chatbot sono ovviamente costruite a partire dall’enorme database di internet, ma anche grazie a ciò che ha imparato dall’utente stesso nel corso della conversazione.

Questo ultimo punto può rivelarsi un’arma a doppio taglio perché a un certo punto potremmo essere noi stessi a influenzare l’IA e farci dire ciò che desideriamo.

Una trappola nella quale è cascato con tutte le scarpe anche l’avvocato Steven Schwartz che si è affidato proprio a ChatGPT per la risoluzione di un caso giudiziario.

Il legale ha chiesto al chat bot di fornire argomentazioni per le sue tesi, salvo poi scoprire in sede di processo di aver fatto l‘errore più grosso della sua vita.

ChatGPT “falsifica” un processo: il curioso caso dell’avvocato Schwartz

Il processo del quale ChatGPT è diventato tristemente protagonista è quello della causa mossa da un tale Roberto Mata nei confronti della compagnia aerea colombiana Avianca Airlines.

Il signor Mata ha accusato la società poiché, durante il volo a bordo di uno dei loro aerei, era stato colpito e ferito al ginocchio da un carrello di servizio.

L’avvocato Stefan Schwartz è stato chiamato a difesa proprio del signor Mata e per avvalere la sua tesi ha chiesto aiuto a ChatGPT.

Il legale ha infatti chiesto al chatbot se nella storia ci fossero stati dei casi simili a quelli del signor Mata ed eventualmente elencarli.

ChatGPT, dopo qualche minuto, ha iniziato a elencare diversi casi simili, addirittura riportando i nomi e cognomi dei passeggeri coinvolti e anche il nome di compagnie aree realmente esistenti.

L’avvocato Schwartz, fidandosi della parola dell’IA, ha preso tutto per buono salvo poi scoprire che si trattava di casi mai avvenuti.

A quanto pare, spinto dalla volontà di risolvere il caso, l’avvocato Schwartz aveva in qualche modo, magari inavvertitamente, portato ChatGPT a scrivere la risposta che desiderava.

Questo ha portato il chatbot a “compiacere” l’utente umano dall’altra parte dello schermo addirittura inventando casi giudiziari mai avvenuti.

Questo caso unico nel suo genere ha portato il giudice a rimandare l’udienza e aprirla successivamente per discutere potenziali sanzioni nei confronti dell’avvocato.